大模型

揭秘大模型的魔法:实现带可训练权重的自注意力机制

大家好,我是写代码的中年人。 上一篇我们实现了一个“无可训练参数”的注意力机制,让每个词都能“看看别人”,计算出自己的上下文理解。 虽然实现起来不难,但它只是个“玩具级”的注意力,离真正的大模型还差了几个“亿”个参数。

8/4/2025 9:31:49 AM

写代码的中年人

阶跃星辰新一代基础大模型 Step 3 正式开源:拥有强大视觉感知和复杂推理能力

AI在线 7 月 31 日消息,阶跃星辰宣布新一代基础大模型 Step 3 正式开源,Step 3 API 已上线阶跃星辰开放平台(platform.stepfun.com),用户也可以在“阶跃 AI”官网(stepfun.com)和“阶跃 AI”App 进行体验。 据介绍,Step 3 的多模态能力围绕“轻量视觉路径”与“稳定协同训练”展开,重点解决视觉引入带来的 token 负担与训练干扰问题。 为此,其采用 5B Vision Encoder,并通过双层 2D 卷积对视觉特征进行降采样,将视觉 token 数量减少到原来的 1/16,减轻上下文长度压力,提升推理效率。

7/31/2025 10:18:00 PM

远洋

我国大模型应用个人用户注册超 31 亿

AI在线 7 月 31 日消息,据中国新闻网报道,记者从国家网信办获悉,当前 AI 正通过网页、移动应用、API 接口、本地部署、云服务部署等多种方式为用户提供服务。 据不完全统计,大模型应用的个人用户注册总数已超过 31 亿,API 调用用户总数超过 1.59 亿。 AI在线注意到,今年以来我国基础大模型的迭代速度加快,大模型在电子、原材料、消费品等行业加快落地。

7/31/2025 11:50:05 AM

浩渺

刚刚,扎克伯克公开信:Meta不会开源全部模型

Meta 联合创始人兼首席执行官马克・扎克伯格从 OpenAI、谷歌和苹果等公司挖走了众多顶尖 AI 研究人员,并开出了数亿美元的薪酬,此举震惊了整个科技行业。 现在,他正在更多地分享他对超级智能的愿景。 在 Meta 财报电话会议召开前几个小时,扎克伯格一封公开信广为传播。

7/31/2025 9:31:52 AM

机器之心

让 Gemini CLI 跑在你的私有大模型上

前不久,Google 开源了 Gemini CLI 工具,它允许用户通过命令行与 Gemini AI 模型进行高效交互。 然而,在实际应用中,出于安全性和成本控制的考虑,很多场景更适合使用本地部署的大语言模型(LLM)。 因此,让 Gemini CLI 支持连接本地 LLM 就显得尤为重要。

7/31/2025 6:45:00 AM

Andflow

逆天!旧Mac上能run千亿参数SOTA!效果惊人:一次生成游戏,0修改!本地大模型拐点来了!网友:别被大模型叙事带偏了(附指南)

编辑 | 伊风出品 | 51CTO技术栈(微信号:blog51cto)起猛了,连老电脑都能跑智谱家新一代的 SOTA 模型了! 一篇来自技术人 Simon Willison(Python 知名 Web 框架 Django 的共同创始人)的实测文章,在 Hacker News 上引发热议:“我 2.5 年高龄的旧笔记本,现在不仅能在本地跑千亿参数模型,甚至还能用它写出一款完整的 JavaScript 太空入侵者游戏。 ”图片 这个模型,正是昨天新鲜出炉的 GLM-4.5 系列。

7/30/2025 2:11:55 PM

伊风

大模型中的嵌入向量

前面文章和小伙伴们聊了 Tokenizer,经过 Tokenizer 之后,自然语言变为 Token,那么大模型就可以直接训练 Token 了嘛? 还不行! 接下来还有一个词嵌入的环境,英文就是 Embedding,Embedding 实际上就是将 Token 转为张量,在有的场景下,Embedding 也指张量本身。

7/30/2025 4:15:00 AM

江南一点雨

国内首个,MiniMax 大模型通过人机辩论图灵测试

AI在线 7 月 29 日消息,据央视频今日报道,在 2025 中国 AI 盛典现场,一场人机辩论激烈上演,而围绕辩论的“图灵测试”也顺利通过。 奇葩说辩手陈铭与 MiniMax 大模型辩手展开辩论,现场有超过 30% 的观众被 AI“迷惑”了,根据“图灵测试”规则,测试通过。 AI在线注:图灵测试(Turing test)是英国计算机科学家艾伦・图灵于 1950 年提出的思想实验,这个实验的流程是由一位询问者写下自己的问题,随后将问题发送给在另一个房间中的一个人与一台机器,由询问者根据他们所作的回答来判断哪一个是真人,哪一个是机器,所有测试者都会被单独分开,对话以纯文本形式透过屏幕传输,因此结果不取决于机器的语音能力,这个测试意在探求机器能否模仿出与人类相同或无法区分的智能。

7/29/2025 7:03:58 PM

汪淼

只需一次指令微调,大模型变身全能专家天团,8B模型性能反超全微调基线 | ACL25 Oral

只需一次指令微调,即可让普通大模型变身“全能专家天团”? 改造位置自动定位专家协作动态平衡8B模型性能反超全微调基线1.6%,安全指标暴涨10%,推理内存直降30%! 图片当前预训练语言大模型(LLM)虽具备通用能力,但适应专业领域需高昂的指令微调成本;稀疏混合专家(SMoE)架构作为可扩展的性能-效率平衡框架,虽能提升推理效率并灵活扩展模型容量,但其从头训练消耗巨大资源,因此复用密集大模型参数的升级改造(LLM Upcycling)成为更具成本效益的替代方案。

7/29/2025 2:12:00 AM

百元级硬件流畅运行百亿参数大模型!上交&本智激活开源端侧原生大模型

AI的下一个战场,不在云端,而在你的口袋里。 iPhone、华为、三星、小米、OPPO等各大手机厂商几乎都在将大模型塞进手机,端侧AI已然成为兵家必争之地。 背后的逻辑清晰而坚定:最懂你的AI,必须能安全地访问你的个人数据——邮件、照片、日程,而这一切的前提,就是将计算留在本地,将隐私还给用户。

7/28/2025 9:06:00 AM

大模型“天梯赛”来了,让Agent在Kaggle真实任务中进化|佐治亚理工、斯坦福开源

当前最强大的大语言模型(LLM)虽然代码能力飞速发展,但在解决真实、复杂的机器学习工程(MLE)任务时,仍像是在进行一场“闭卷考试”。 它们可以在单次尝试中生成代码,却无法模拟人类工程师那样,在反复的实验、调试、反馈和优化中寻找最优解的真实工作流。 为了打破这一瓶颈,来自佐治亚理工学院和斯坦福大学的研究团队正式推出了 MLE-Dojo,一个专为训练和评测大模型智能体(LLM Agents)设计的“交互式武馆”。

7/28/2025 8:45:00 AM

协同 RAG-Reasoning:让大模型边想边查的“深度研究”范式

大家好我是肆〇柒。 在AI领域,大型语言模型(LLM)已经展现出卓越的语言生成能力,并在诸多任务中取得了显著成果。 然而,LLM 存在两大局限:一是知识幻觉,因其知识存储静态且参数化,易生成错误内容;二是复杂推理能力不足,难以应对现实世界的复杂问题。

7/28/2025 3:00:00 AM

肆零柒

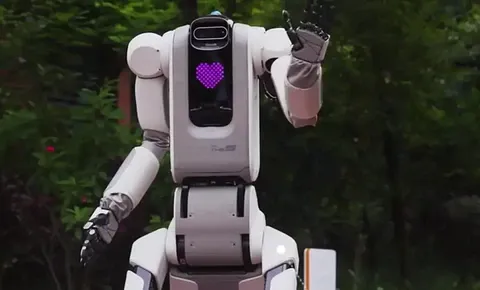

腾讯Robotics X具身智能开放平台Tairos发布,融合左脑、右脑、小脑

感知、规划、行动分别对照着人类的右脑、左脑和小脑。 现场,搭载了Tairos的宇树机器人“小腾”可以听懂并遵照“到我身边来”的指令,看得见也说得清桌面上的物体,能弄明白物体增添变化,记得起自己昨天在做什么。 这意味着,机器人开始具备长记忆能力。

7/27/2025 5:05:00 PM

丁莉

我国大模型数量居全球首位,达到 1509 个、占比达 40%

AI在线 7 月 27 日消息,据央视新闻报道,今年以来我国基础大模型的迭代速度加快,大模型在电子、原材料、消费品等行业加快落地。 记者从世界人工智能大会上获悉,当前全球已发布的大模型总数达到 3755 个,其中,我国企业贡献了 1509 个(AI在线注:占比达 40%),数量居全球首位。 据AI在线此前报道,中国互联网络信息中心(CNNIC)今年 7 月在京发布第 56 次《中国互联网络发展状况统计报告》。

7/27/2025 1:24:44 PM

浩渺

WAIC 2025 主论坛演讲 | MiniMax 创始人闫俊杰:每个人的 AI

2025世界人工智能大会(WAIC)于今日在上海开幕。 作为全球人工智能领域的顶级盛会,本届大会以“智能时代 同球共济”为主题,汇聚全球智慧,展现中国方案。 活动首日,MiniMax创始人、CEO闫俊杰先生作为特邀嘉宾出席大会开幕式并在大会主论坛(上午场)发表主题演讲《每个人的AI》(Everyone's AI)。

7/26/2025 4:47:00 PM

陈彩娴

WAIC 2025|阶跃发布新一代基模 Step 3:原生多模态,推理效率行业领先

在2025世界人工智能大会(简称“WAIC 2025”)开幕前夕,阶跃星辰今天在上海正式发布了新一代基础大模型——Step 3。 作为阶跃的主力基座模型,Step 3兼顾智能与效率,旨在面向推理时代打造最适合应用的模型。 Step 3将于7月31日面向全球企业和开发者开源,为开源世界贡献最强多模态推理模型。

7/25/2025 9:43:00 PM

陈彩娴

讯飞星火 X1 升级版模型宣布上线:整体效果对标 OpenAI o3 等国内外一流大模型

AI在线 7 月 25 日消息,科大讯飞今日发布公告,宣布基于全国产算力训练的深度推理大模型 —— 讯飞星火 X1 升级版正式上线。 此次升级,星火 X1 在多个任务上持续进步,综合能力再升级,特别是在翻译、推理、文本生成、数学、多语言上效果亮眼。 同时,在幻觉治理方面,对于大模型自身生成内容是否符合客观事实的事实性幻觉治理,以及在用户给定额外参考资料时大模型回复是否忠于原文的忠实性幻觉治理两方面均取得明显进步,显著提高了大模型行业落地应用的可靠性。

7/25/2025 1:38:15 PM

问舟

李沐B站更新了!教你手搓语音大模型,代码全开源还能在线试玩

这一天,辣个男人终于回想起……他的小破站账号! (活久见)李沐老师终于带着他的手搓语音大模型教程回归了….本期视频不讲论文,李沐老师来手把手教大家怎样玩转他们团队最新研发的Higgs Audio V2模型,不仅能处理文本,还能同时理解并生成语音。 除了一些常规语音任务外,这个模型还具备一些较为罕见的能力,比如生成多种语言的自然多说话人对话、旁白过程中的自动韵律调整、使用克隆声音进行旋律哼唱以及同时生成语音和背景音乐。

7/24/2025 8:55:00 AM

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

DeepSeek

谷歌

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

AI新词

微软

智能

用户

GPT

学习

技术

智能体

马斯克

Gemini

图像

Anthropic

英伟达

AI创作

训练

LLM

论文

代码

算法

Agent

AI for Science

芯片

苹果

Claude

腾讯

Stable Diffusion

蛋白质

开发者

生成式

神经网络

xAI

机器学习

3D

RAG

人形机器人

AI视频

研究

大语言模型

生成

具身智能

Sora

工具

GPU

百度

华为

计算

字节跳动

AI设计

AGI

大型语言模型

搜索

视频生成

场景

深度学习

架构

生成式AI

DeepMind

编程

视觉

Transformer

预测

亚马逊

AI模型

特斯拉

MCP